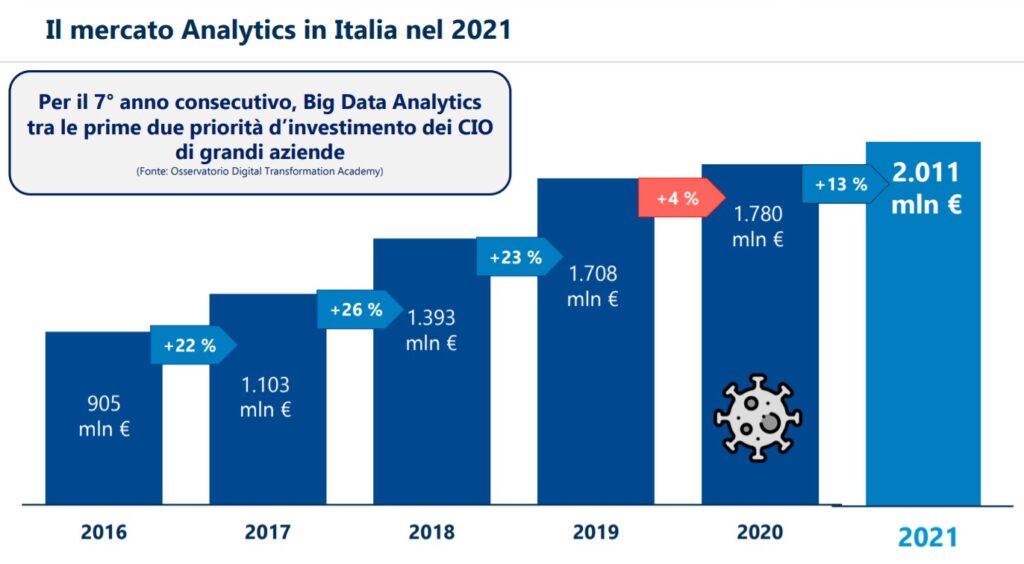

Dopo che nel 2020 la pandemia aveva fortemente rallentato gli investimenti in ambito gestione e analisi dei dati, il mercato italiano riparte e nell’anno in corso raggiungerà un valore stimato superiore ai 2 miliardi di euro, in crescita del 13% in 12 mesi.

La crescita è trainata soprattutto dalla componente software, che registra un incremento del 17%, con punte di oltre il 30% per le piattaforme di Data governance, Data science e AI, e dai servizi di consulenza e personalizzazione tecnologica, mentre la spesa in risorse infrastrutturali aumenta meno della media del mercato.

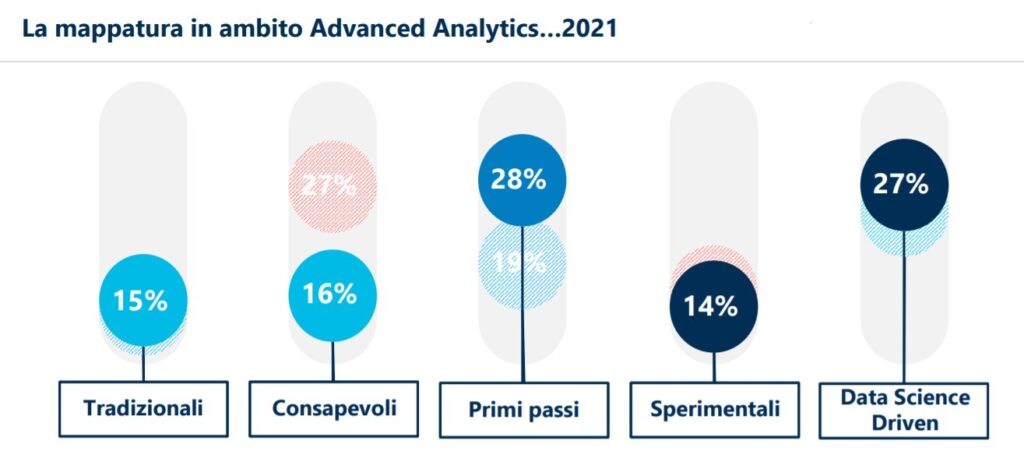

Le sperimentazioni di Advanced analytics sono state avviate nel 54% delle grandi imprese (46% nel 2020), ma solo il 27% può definirsi ‘data science driven’, cioè con competenze diffuse e progetti a regime in tutta l’organizzazione aziendale.

Quello dei Big data e analytics è un mondo in grande fermento – e uno dei pilastri che sostengono l’Industria 4.0 –, e l’Osservatorio Big data e business analytics del Politecnico di Milano ne delinea lo scenario nel suo report annuale. Ne emerge anche la forte crescita degli investimenti in software (+17%), e un quinto della spesa in Analytics passa dal Public Cloud (+21%): Assicurazioni, manifatturiero, Telco e media sono i comparti con la crescita più marcata.

La ripresa coinvolge tutti i settori merceologici, con investimenti in Data management e analytics in aumento di oltre il 10%, con un quinto degli investimenti in soluzioni di analytics passa da servizi in Public e Hybrid cloud, per un +21% rispetto al 2020.

“Nonostante la crescita registrata nel 2021, non possiamo ancora considerare colmato quel gap tra aziende già a buon punto nella valorizzazione dei dati e quelle all’inizio del percorso”, fa notare Carlo Vercellis, responsabile scientifico dell’Osservatorio Big data e business analytics.

Inoltre, nonostante una diffusa voglia di sperimentazione, “poche aziende italiane oggi possono essere considerate veramente data driven, cioè capaci di portare l’intera organizzazione a una piena valorizzazione dei dati a disposizione. Per far sì che la Data Science abbia un impatto concreto, è necessario creare una cultura dei dati che, a diversi livelli, avvicini sempre più lavoratori ad un uso quotidiano di insights e risultati delle analisi”.

Indice degli argomenti

Le sperimentazioni di Advanced analytics

Negli ultimi tre anni oltre la metà delle grandi imprese ha avviato almeno una sperimentazione in ambito Advanced analytics, otto punti percentuali in più rispetto a un anno fa. Circa quattro aziende su dieci hanno progetti operativi in almeno una funzione aziendale, ma nella maggior parte dei casi la diffusione è limitata ad alcune aree.

Le principali difficoltà riscontrate dalle aziende nella fase di implementazione sono la scarsa qualità e integrazione dei dati, la parziale mancanza di competenze interne, la difficoltà di valutare i benefici del singolo progetto e infine il complesso coinvolgimento dell’utente di business.

Nel corso dell’ultimo anno “c’è stato un nuovo boom dell’eCommerce a livello mondiale, cresciuto di oltre 500 miliardi di dollari e passando dal 16 al 19% delle vendite globali, sia B2c che B2b”, sottolinea Daniele De Vita, Chief analytics officer in Bnp Paribas, per cui “c’è la necessità di gestire questa complessità su scala industriale per governare l’intero ciclo di vita del dato”. E per fare questo “serve sempre più flessibilità”.

Le competenze di Data science

L’accelerazione del mercato e l’aumento delle sperimentazioni richiedono nuove competenze. Il 49% delle grandi aziende italiane ha in organico almeno un Data scientist e il 59% almeno un Data engineer. I numeri in termini di diffusione sono stabili rispetto allo scorso anno, ma le realtà che avevano già introdotto questi profili in precedenza hanno continuato a investire: il numero di Data scientist è cresciuto nel 28% dei casi.

Usare intelligenza artificiale applicata ai Big data

Un’altra delle tendenze più interessanti in atto riguarda la cosiddetta Advanced data analytics, ovvero l’uso di sistemi e risorse di intelligenza artificiale applicati all’analisi e gestione dei dati. È sempre più utile e vantaggioso “usare strumenti di AI anche in questo campo, perché permettono di svolgere in automatico molte operazioni ripetitive e a basso valore aggiunto, sgravandole dall’intervento umano”, rimarca Alessandro De Bettin, Data scientist in PwC Italia.

In più, questi sistemi permettono di usare le informazioni e trovare velocemente le risposte e le soluzioni cercate, attraverso l’applicazione di Best practice, “e tutto ciò semplifica di molto le varie operazioni necessarie”, sottolinea De Bettin.

A Venezia “abbiamo creato una Smart control room che utilizza una Urban intelligence platform”, spiega Susanna Jean, Marketing manager 5G di Tim. In questo modo “è possibile raccogliere e integrare tra loro tutti i dati di diversa provenienza che riguardano la città e il territorio di Venezia”, per applicazioni operative che riguardano la sicurezza, il turismo, la pianificazione di altre attività sul territorio.

Una di queste applicazioni “riguarda ad esempio la gestione dei servizi sanitari durante l’emergenza pandemica”, fa notare Jean, “e anche la gestione e l’uso delle ambulanze di soccorso anche in base alle previsioni o alla presenza di Acqua alta in città”.

L’analisi e l’utilizzo dei dati in tempo reale

Anche la possibilità di analizzare e quindi utilizzare i Big data subito, in tempo reale, è un aspetto e una funzione che risultano sempre più rilevanti per le aziende, innanzitutto quando si tratta di gestire delle emergenze, come guasti e malfunzionamenti. Ma non solo.

“Prendiamo il caso di una fabbrica siderurgica e di una fonderia”, osserva Paride Morrone, Regional sales manager in Vertica: “qui appositi sensori sono in grado di rilevare eventuali anomalie, e inviano i dati ai sistemi computerizzati: questi dati devono naturalmente essere processati subito, nel giro di pochi secondi, perché devono scattare immediatamente le contromisure”.

Quelle di una emergenza per motivi di sicurezza è anche un caso estremo, ma ci sono moltissime situazioni ed esigenze per cui le decisioni degli operatori e dei manager vanno prese in tempo reale, nel giro di qualche ora al massimo, in sostanza nel più breve tempo possibile. “Il tempo è ormai una variabile fondamentale in molte attività di business”, sottolinea il sales manager di Vertica, “la velocità di decisioni e operazioni fa la differenza”.

Gli analytics nelle piccole e medie imprese

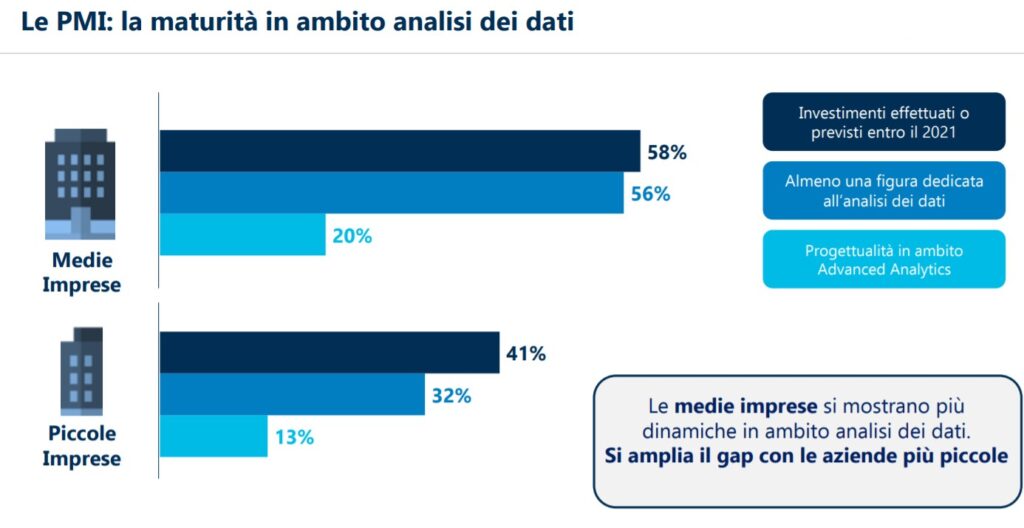

Nel 2021, il 44% delle piccole e medie imprese ha investito in Analytics o prevede di farlo entro fine anno, e un altro 44% ritiene che la pandemia ha avuto un ruolo determinante nell’acquisire maggiore consapevolezza sulla necessità di valorizzare i dati a disposizione.

Ancor di più che negli scorsi anni, si notano importanti differenze tra la maturità delle medie e delle piccole imprese: il 58% delle prime ha investito in risorse fisiche o umane di Analytics o prevede di farlo entro fine anno, contro il 41% delle piccole aziende.

Rispetto al 2020, non ci sono stati progressi né per quanto riguarda le tipologie di analisi dati sviluppate né la gestione organizzativa dell’analisi dei dati, tematiche che probabilmente nuove realtà affronteranno nei prossimi anni, mentre è aumentato l’impegno sugli investimenti tecnologici, con circa un’azienda su due che afferma di aver lavorato per integrare i dati interni.

‘Abbattere’ i silos tra settori aziendali diversi

La maggior parte delle PMI svolge oggi analisi predittive (62%), ma le sperimentazioni di Advanced analytics sono presenti solo in una ristretta minoranza (14%). Un terzo del campione ha figure dedicate alla gestione dell’analisi dei dati nella funzione IT o distribuite nelle diverse funzioni aziendali, in particolare Data analyst.

Un’altra esigenza – non nuova ma spesso ancora irrisolta – riguarda la necessità di gestire i dati abbattendo i silos e i compartimenti stagni che troppo spesso tengono separate aree e funzioni aziendali diverse.

“I dati, oltra che raccolti, vanno integrati tra quelli di funzioni diverse, e condivisi, messi a fattor comune”, rileva Andrea Zinno, data evangelist in Denodo, “e anche su questo aspetto nelle imprese c’è ancora molto da lavorare”.