ABB Robotics integrerà le librerie Nvidia Omniverse all’interno di RobotStudio, la propria suite software per la programmazione, la progettazione e la simulazione robotica. L’obiettivo è colmare definitivamente il cosiddetto “sim-to-real gap” – il divario storico tra la fedeltà delle simulazioni virtuali e il comportamento dei robot nel mondo reale – aprendo la strada a un utilizzo industriale dell’intelligenza artificiale fisica (physical AI) su larga scala.

Indice degli argomenti

Cosa cambia con RobotStudio HyperReality

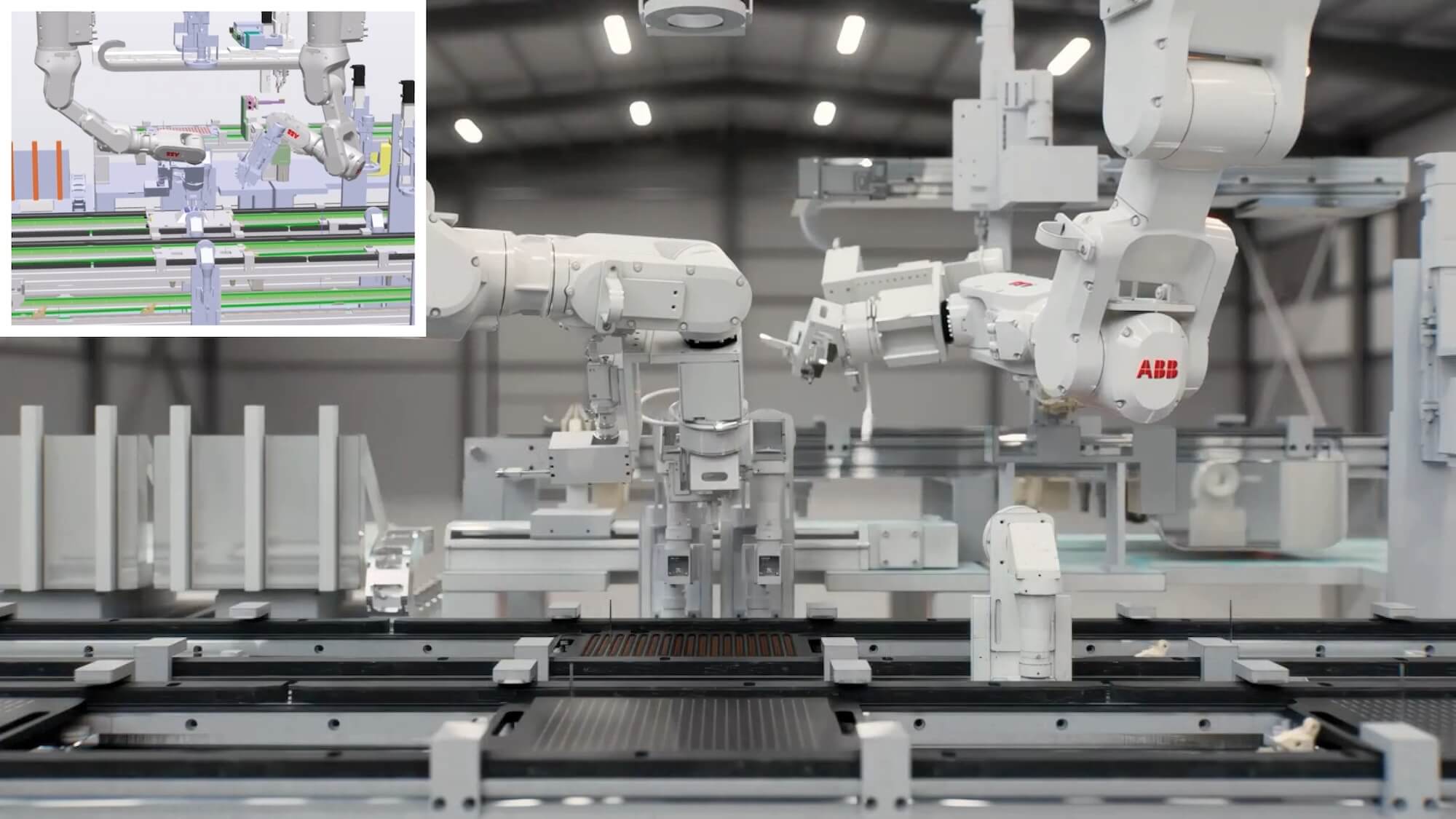

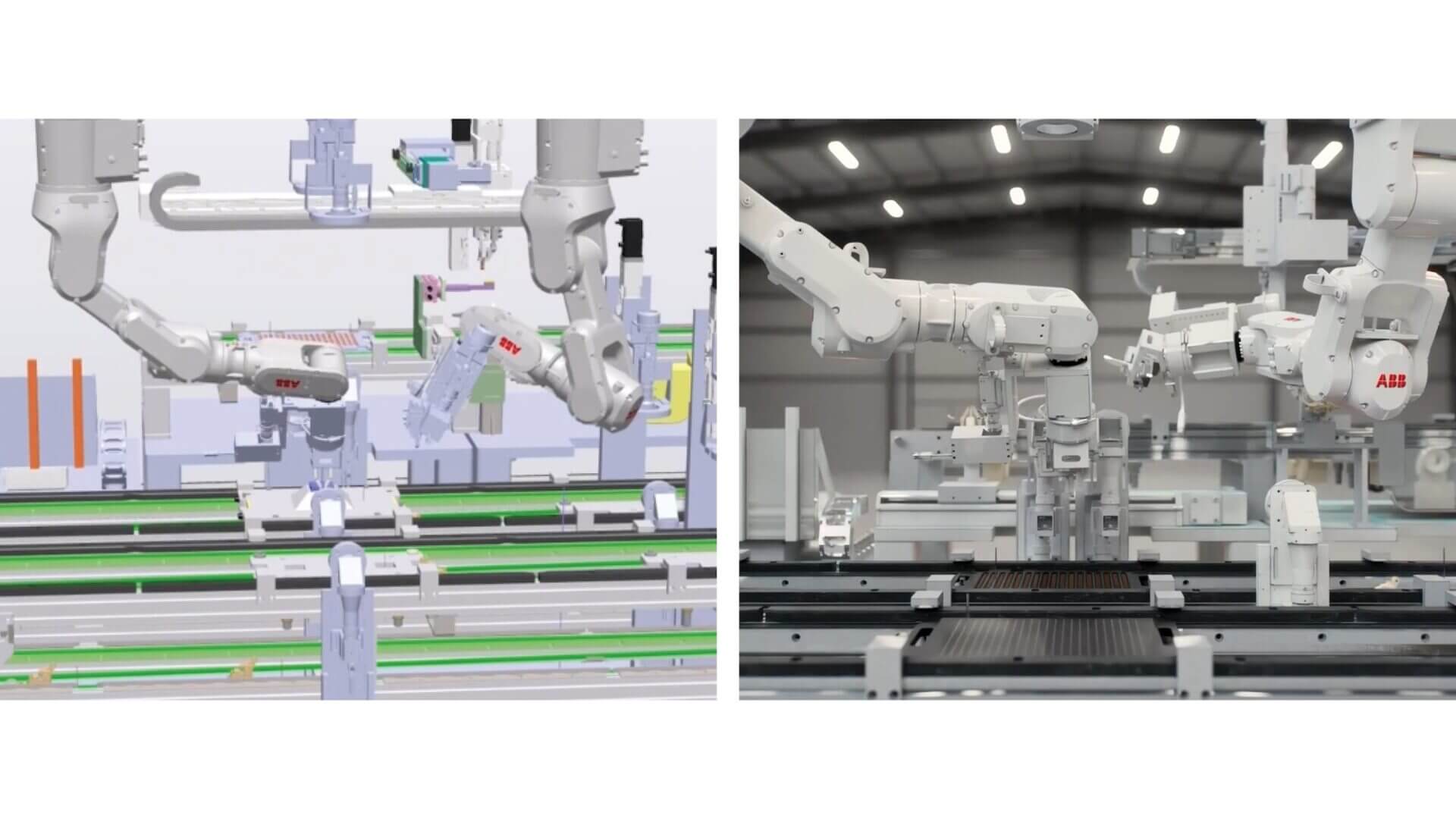

La nuova soluzione, denominata RobotStudio HyperReality, sarà disponibile nella seconda metà del 2026 in abbonamento per i circa 60.000 clienti RobotStudio di ABB nel mondo. Il principio alla base è semplice: integrare la potenza di simulazione fisicamente accurata di Nvidia Omniverse con il controllore virtuale di ABB – l’unico sul mercato che esegue lo stesso firmware dell’hardware reale – per garantire una corrispondenza quasi perfetta tra ambiente simulato e prestazioni fisiche.

Mentre le simulazioni tradizionali si limitavano spesso a rappresentare le telecamere e i sensori come semplici modelli grafici o “disegni” privi di profondità fisica, RobotStudio HyperReality introduce un livello di dettaglio ambientale senza precedenti. La piattaforma è in grado di ricreare virtualmente condizioni critiche che solitamente mandano in crisi i sistemi di visione artificiale nel mondo reale: ombre radenti, riflessi complessi, vibrazioni provocate da macchine industriali in movimento, o la presenza di nebbie di vernice e vapore tipici degli ambienti di fonderia.

Poter addestrare l’intelligenza artificiale in un ambiente “industrial-grade” che replica fedelmente queste interferenze permette di generare modelli di IA estremamente robusti. Questo significa che il robot non viene più programmato per seguire una traiettoria rigida, ma impara a “percepire” e reagire correttamente al suo ambiente già nella fase virtuale, arrivando sulla linea di produzione con una precisione di trasferimento del 99%. In questo modo le aziende possono eliminare i costosi e lunghi cicli di test fisici e la necessità di ricalibrare i sensori sul campo, poiché il robot ha già “vissuto” e superato le difficoltà dell’ambiente di fabbrica all’interno della simulazione

A questo si aggiunge la tecnologia Absolute Accuracy di ABB, che riduce gli errori di posizionamento da un intervallo di 8-15 mm a circa 0,5 mm, rendendo la soluzione adatta ad applicazioni industriali ad alta precisione. Il risultato dichiarato è una precisione di trasferimento dalla simulazione alla realtà fino al 99%, con tempi di setup e messa in servizio ridotti fino all’80%.

I benefici quantificati da ABB riguardano tre aree: riduzione dei costi fino al 40% grazie all’eliminazione dei prototipi fisici, accelerazione del time-to-market del 50% per prodotti complessi come l’elettronica di consumo, e la possibilità di progettare, testare e ottimizzare le linee di produzione interamente in ambiente virtuale prima di toccare l’hardware reale.

“Oggi, usando le tecnologie di accelerated computing e simulazione di Nvidia, abbiamo rimosso le ultime barriere per rendere la physical AI industriale una realtà su scala globale, colmando il sim-to-real gap”, ha dichiarato Marc Segura, President di ABB Robotics.

I casi d’uso reali: da Foxconn alle PMI americane

Foxconn, il più grande produttore a contratto di elettronica al mondo, sta già conducendo il primo progetto pilota nell’assemblaggio di componenti per l’elettronica di consumo. Il caso è emblematico delle difficoltà tipiche del settore: componenti miniaturizzati, varianti di prodotto multiple e strutture metalliche delicate che richiedono operazioni di pick-and-place di estrema precisione, con tempi di debug spesso elevati. Con RobotStudio HyperReality, i robot di assemblaggio Foxconn vengono addestrati virtualmente con dati sintetici, ottimizzando più processi produttivi in parallelo prima del trasferimento in linea.

Foxconn usa la simulazione per l’assemblaggio di piccolissimi pulsanti dove le telecamere reali falliscono a causa delle ombre nel foro di inserimento. In HyperReality, il robot viene addestrato “al buio” nel mondo reale, seguendo una traiettoria perfetta imparata virtualmente.

“La precisione è tutto nella produzione di elettronica di consumo e fino ad ora questo livello di accuratezza e fedeltà semplicemente non era possibile nella simulazione e nei digital twin”, ha commentato Dr. Zhe Shi, Chief Digital Officer di Foxconn.

Sul fronte delle piccole e medie imprese americane opera invece Workr, una società californiana specializzata in forza lavoro robotica. A Nvidia GTC 2026 (16-19 marzo, San Jose, California) l’azienda dimostrerà sistemi robotici basati su tecnologia ABB, addestrati con dati sintetici tramite le librerie Nvidia Omniverse e operabili senza alcuna competenza di programmazione. La piattaforma proprietaria WorkrCore AI di Workr consente ai robot di apprendere nuovi compiti in pochi minuti, indirizzandosi esplicitamente al problema della carenza di manodopera qualificata che affligge il manifatturiero statunitense.

“Proprio come ChatGPT ha cambiato il mondo rendendo l’IA accessibile a chiunque, stiamo portando la stessa tecnologia nella robotica” ha detto Deepu Talla Vice President Robotics and Edge AI, Nvidia. “L’obiettivo è rendere i modelli così intuitivi che gli esseri umani non avranno più bisogno di programmare i robot, ma potranno semplicemente istruirli o insegnare loro cosa fare.”

L’annuncio si inserisce in una collaborazione già consolidata tra le due aziende, che in precedenza aveva portato all’integrazione di Nvidia Jetson nei robot mobili autonomi con tecnologia Visual SLAM di ABB e allo sviluppo di data center AI su scala gigawatt. ABB sta inoltre valutando l’integrazione della piattaforma Nvidia Jetson nel proprio controllore Omnicore per abilitare l’inferenza AI in tempo reale direttamente sull’hardware robotico.