L’accelerazione dell’adozione dell’AI agenticale sta spingendo CEO e responsabili HR a interrogarsi su una questione che fino a pochi anni fa sembrava fantascienza: se le macchine possono fare quasi tutto, cosa resta all’uomo? La risposta di Forrester Research, nel report “What Will Humans In The Loop Do?“, è che il lavoro umano non sparirà, ma si trasformerà profondamente – e che le organizzazioni che non si preparano a questa trasformazione rischiano di trovarsi in difficoltà su entrambi i fronti, umano e tecnologico.

Il dato di partenza è già eloquente: il 62% degli adulti online che hanno usato o sentito parlare di AI generativa si dichiara preoccupato per le ricadute occupazionali. E le preoccupazioni non sono infondate. Salesforce, Oracle, IBM e Autodesk stanno già riducendo il personale umano a favore di soluzioni basate sull’AI. Il CEO di Shopify ha chiesto esplicitamente ai propri dipendenti di giustificare perché un compito non possa essere svolto dall’AI prima di richiedere ulteriori risorse. Eppure Forrester stima che entro il 2030 l’AI generativa influenzerà 4,5 volte più posti di lavoro di quanti ne sostituirà direttamente – un indicatore che la trasformazione dei ruoli supererà di gran lunga la loro eliminazione.

Indice degli argomenti

Il nuovo ruolo dell’uomo: sensing, surfacing, soothing

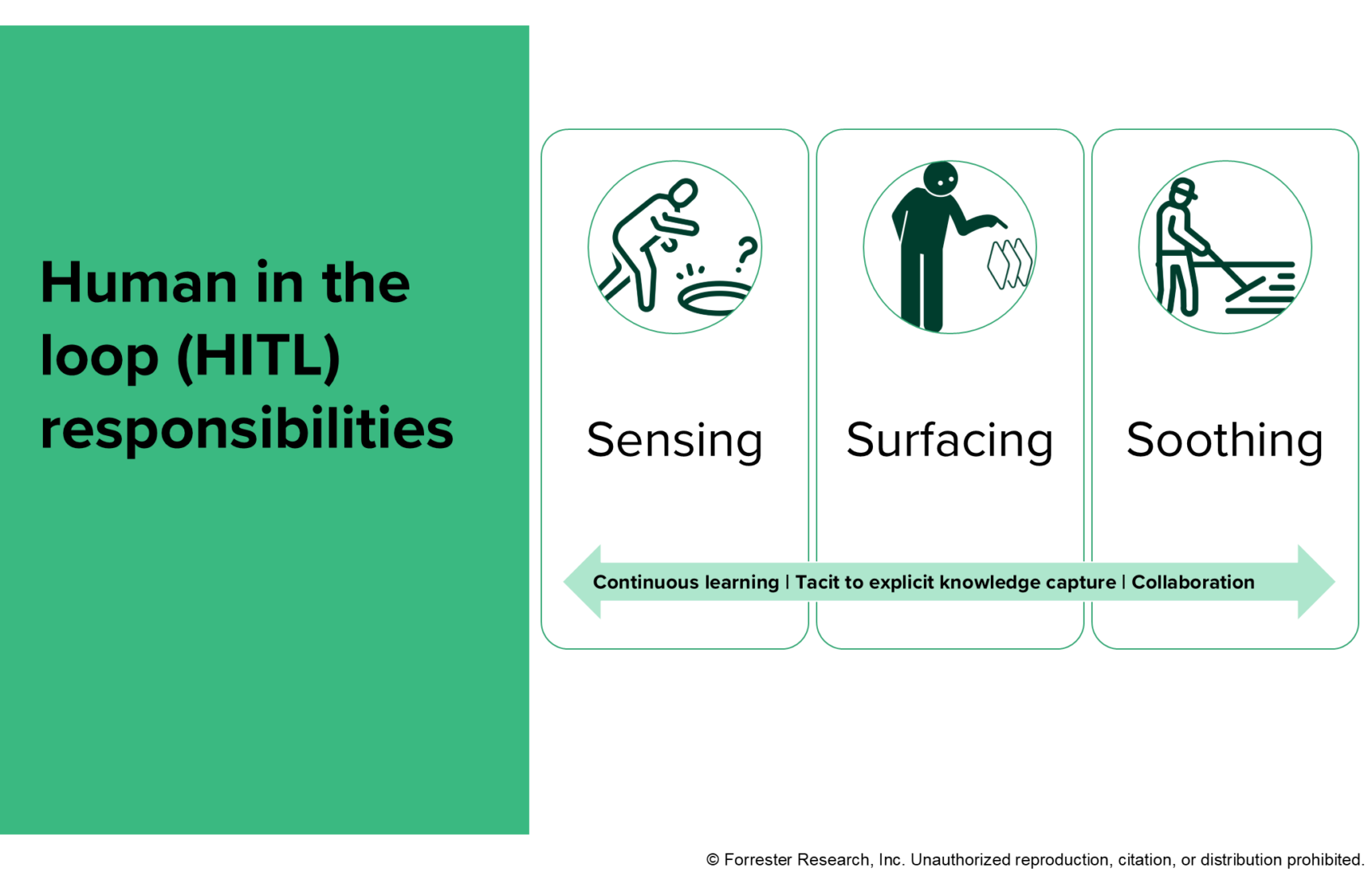

La risposta operativa di Forrester si articola intorno al concetto di “human in the loop” (HITL): persone integrate all’interno, intorno o sopra i sistemi AI con il compito di fungere da validatori, interpreti e supervisori. Il loro ruolo non è semplicemente monitorare il funzionamento degli algoritmi, ma assolvere tre funzioni specifiche che i sistemi automatizzati non riescono a svolgere in autonomia.

La prima è il sensing: rilevare anomalie sottili che l’AI non riesce a intercettare. I dati mancanti, le incongruenze comportamentali, le tensioni comunicative sono segnali che sfuggono ai modelli ma non all’occhio umano. Un esempio citato nel report riguarda la piattaforma Soundslice: il suo creatore, Adrian Holovaty, notò che gli utenti stavano caricando screenshot di tablature ASCII generate da ChatGPT anziché spartiti veri, perché il modello li indirizzava erroneamente verso una funzionalità che la piattaforma non offriva. Senza l’osservazione umana, il problema sarebbe rimasto invisibile.

La seconda funzione è il surfacing: portare in superficie problemi nascosti o soluzioni non ovvie. Gli esseri umani agiscono da traduttori tra sistemi AI isolati e il processo decisionale aziendale, rendendo espliciti problemi etici, zone cieche algoritmiche o insoddisfazioni degli utenti prima che diventino crisi. Nel caso di Soundslice, Holovaty non si limitò a identificare l’allucinazione di ChatGPT: costruì concretamente la funzionalità che il modello aveva erroneamente descritto, trasformando un problema in un miglioramento di prodotto.

La terza è il soothing: mitigare le conseguenze degli errori AI e ricostruire la fiducia quando i sistemi automatizzati causano danni o malintesi. Questa funzione – che richiede intelligenza emotiva, gestione del conflitto e capacità relazionale – è forse la più difficile da replicare con l’automazione.

Le competenze che contano nell’era degli agenti AI

Per assolvere queste funzioni, i lavoratori “human in the loop” devono padroneggiare una combinazione di competenze tecniche e relazionali. Sul fronte delle soft skill contano la capacità narrativa, l’intelligenza emotiva, la gestione del cambiamento e l’ascolto attivo – strumenti indispensabili per contestualizzare gli output dei modelli AI e gestire le interazioni nei momenti critici. Sul fronte tecnico sono richieste la data literacy, il prompt engineering e la gestione della conoscenza organizzativa, con una comprensione di base di matematica, principi di programmazione e logica dei sistemi. Microsoft e LinkedIn identificano la AI literacy come la competenza più richiesta entro il 2025, con figure emergenti come i “workflow designer” e i “software operator” già considerate strategiche per le aziende.

Il rischio opposto – ridurre il personale troppo rapidamente – è documentato da un caso concreto: Klarna, dopo aver tagliato risorse umane nel servizio clienti, si è trovata a riassumerle perché le attività richiedevano capacità che i sistemi automatizzati non erano in grado di replicare. La conoscenza tacita – quella non documentata, frutto di esperienza e contesto – è un asset che alimenta i sistemi AI e che scompare con le persone. Forrester raccomanda esplicitamente un approccio ibrido: bilanciare le riduzioni di personale con la riqualificazione interna, mantenere aperte le pipeline di ingresso per i profili junior e investire in programmi di upskilling che misurino non solo la produttività ma anche il benessere dei lavoratori.

Il messaggio centrale del report è che la domanda giusta non è “quanti lavoratori può sostituire l’AI?” ma “come progettiamo un’organizzazione capace di sfruttare al meglio sia le macchine sia le persone?” La risposta richiede una visione che le aziende manifatturiere – già alle prese con la trasformazione digitale – farebbero bene ad anticipare piuttosto che subire.