Universal Robots ha scelto il GTC 2026 – la conferenza di Nvidia che si tiene dal 16 al 19 marzo a San Jose in California – per presentare UR AI Trainer, una soluzione sviluppata in collaborazione con Scale AI che affronta uno dei problemi più concreti nell’adozione della Physical AI in ambiente industriale: come trasferire in fabbrica modelli addestrati in laboratorio, senza perdere qualità dei dati né affidabilità operativa.

Scale AI è una società americana fondata nel 2016 a San Francisco, specializzata nella produzione di dati di alta qualità per l’addestramento di modelli di intelligenza artificiale. Lavora con grandi imprese e governi per la costruzione, il deployment e la supervisione di applicazioni AI, e conduce attività di ricerca sulla sicurezza e la valutazione dei modelli attraverso il proprio Safety, Evaluations, and Alignment Lab (SEAL).

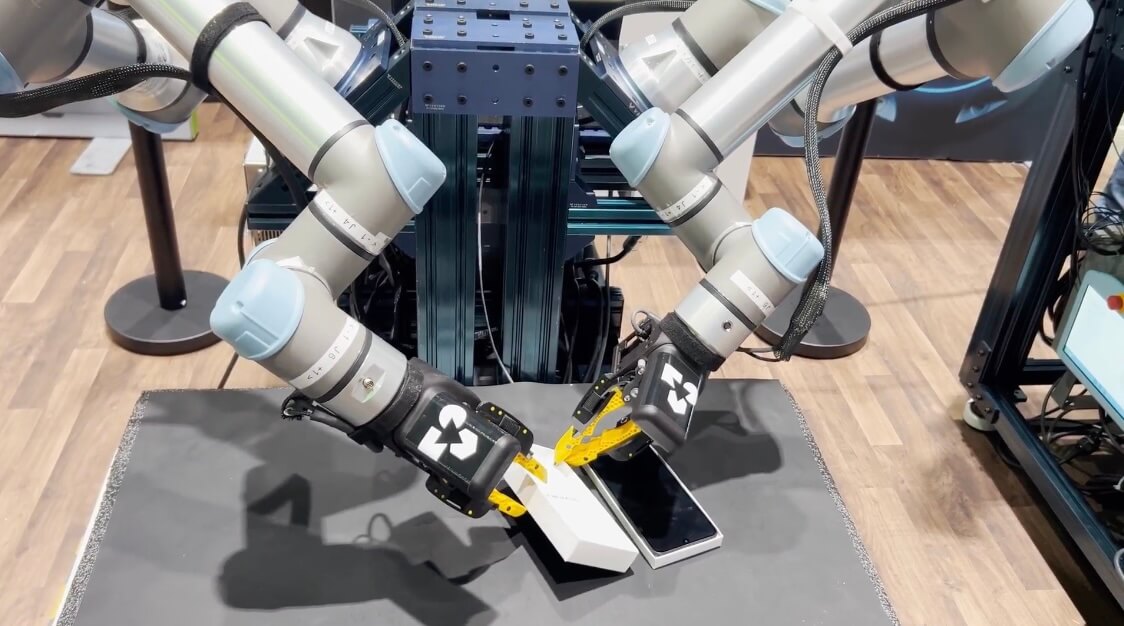

La logica alla base del sistema è quella dell’imitation learning: operatori umani guidano fisicamente un robot “leader” nello svolgimento di un compito, mentre un robot “follower” replica il movimento in tempo reale. Durante ogni dimostrazione il sistema acquisisce in modo sincronizzato dati di movimento, forza e visione, producendo i dataset strutturati necessari per addestrare modelli Vision-Language-Action (VLA). “I nostri clienti non chiedono più soltanto funzionalità di intelligenza artificiale”, ha dichiarato Anders Beck, VP of AI Robotics Products di Universal Robots. “Hanno bisogno di un modo per raccogliere dati robotici e visivi sincronizzati, ad alta fedeltà, per addestrare modelli di AI sugli stessi robot che intendono poi implementare”.

Indice degli argomenti

Il problema della raccolta dati e la risposta del Direct Torque Control

Uno degli ostacoli storici all’addestramento dell’AI in ambito robotico è la frammentazione dell’hardware e la bassa qualità dei dati raccolti. Gran parte dei dataset di training viene prodotta su robot di ricerca non adatti agli ambienti produttivi, e molti sistemi si affidano esclusivamente al feedback visivo, rendendo difficili i compiti che richiedono contatto fisico preciso.

UR AI Trainer affronta questo problema sfruttando il Direct Torque Control e le funzionalità di force feedback proprietarie di Universal Robots. “Diamo agli sviluppatori un controllo diretto sul modo in cui il robot interagisce fisicamente con il mondo, addestrandosi sullo stesso hardware robusto già impiegato in oltre 100.000 installazioni industriali”, ha spiegato Beck. Questo significa che i modelli vengono addestrati sullo stesso hardware su cui poi operano – eliminando il disallineamento tra ambiente di training e ambiente di deployment che spesso vanifica i risultati di laboratorio.

Implementato sulla piattaforma AI Accelerator di UR, il sistema combina i robot UR con il software di Scale AI per abilitare la raccolta dati su larga scala in produzione, generando un feedback continuo per l’ottimizzazione dei modelli. “Universal Robots è presente a livello globale e offre la base ideale per la raccolta dei dati e l’implementazione dell’AI”, ha dichiarato Ben Levin, General Manager Physical AI di Scale AI. “Insieme abbiamo creato un flywheel integrato di dati robotici, che consente ai clienti di addestrare, implementare e migliorare i propri modelli più rapidamente che mai”. Nell’ambito di questa collaborazione UR e Scale AI rilasceranno entro la fine del 2026 un dataset industriale su larga scala raccolto su robot UR.

Simulazione, foundation model e la dimostrazione dal vivo al GTC

Al GTC i visitatori hanno potuto sperimentare UR AI Trainer in prima persona, guidando due robot UR3e “leader” per controllare due robot UR7e “follower” in un’attività di confezionamento di smartphone con feedback aptico, con i dati dimostrativi registrati in tempo reale sullo stack di Scale AI.

Una seconda demo ha mostrato lo stesso scenario in ambiente simulato: realizzato in Nvidia Omniverse e con Isaac Sim, il setup virtuale consente di controllare un sistema bi-manuale UR3e con feedback aptico tramite due dispositivi Haply Inverse3, offrendo una simulazione fisicamente accurata utile per generare dati sintetici di addestramento. Universal Robots sta esplorando anche l’uso del blueprint Nvidia Physical AI Data Factory – un framework preconfigurato che combina strumenti Nvidia per automatizzare la generazione di dati sintetici di addestramento a partire da ambienti simulati – per scalare ulteriormente questa capacità. “Il passaggio verso la Physical AI richiede un cambiamento fondamentale: dall’automazione rigida e pre-programmata a robot generalisti in grado di percepire, ragionare e apprendere”, ha affermato Amit Goel, head of robotics and edge AI ecosystem di Nvidia.

A completare le dimostrazioni, Generalist AI – partner preferenziale di UR per i robotic foundation model – ha mostrato per la prima volta in pubblico i propri modelli embodied in azione: due robot UR7e hanno eseguito in autonomia la stessa attività di confezionamento di smartphone, senza pre-programmazione, dimostrando come dati di training di qualità combinati con architetture di frontiera possano abilitare sistemi di Physical AI operativi oltre i confini del laboratorio.