Attualmente dirigo il Centro di eccellenza di Amazon per la sicurezza delle soluzioni robotiche, meccatroniche e di packaging sostenibile. In questo ruolo ho spesso l’occasione di sottolineare che, poiché i sistemi robotici e di intelligenza artificiale operano sempre più in ambienti umanocentrici, la sicurezza è diventata non solo una sfida progettuale, ma un fattore determinante per ottenere la fiducia degli utilizzatori delle tecnologie e dell’audience globale per garantire la scalabilità a lungo termine. Negli ultimi vent’anni ho lavorato nei settori della robotica, dell’automotive, della logistica e dei sistemi avanzati di intelligenza artificiale per progettare sistemi autonomi che unissero alle performance anche sicurezza, verificabilità e allineamento all’umano.

RObotica sicura

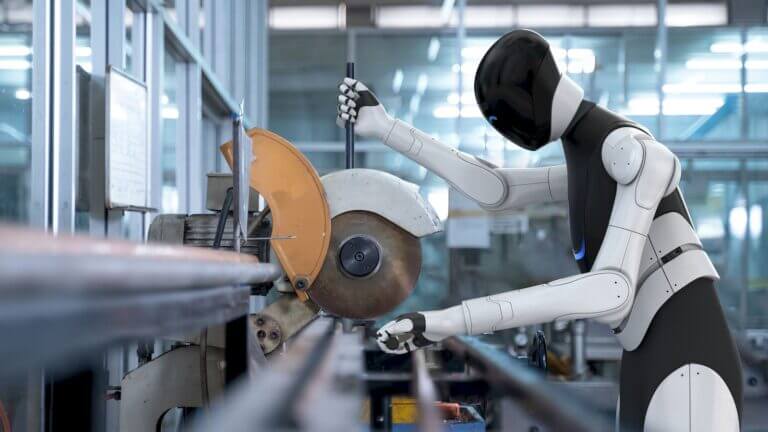

Safe by Design: la nuova frontiera della robotica e dell’ingegneria dei sistemi di intelligenza artificiale

A fronte della crescente diffusione di Robot e IA nelle fabbriche è fondamentale adottare un approccio alla sicurezza che non si limiti al semplice rispetto delle normative, ma che si basi su una ‘fiducia’ concreta e misurabile. Da Gianpiero Negri, responsabile del Centro di eccellenza di Amazon per la sicurezza delle soluzioni robotiche, meccatroniche e di packaging sostenibile, una riflessione su come anticipare i problemi e progettare macchine autonome affidabili, per un futuro che sia tecnologico e che ponga l’uomo al centro.

Amazon Mechatronics and Sustainable Packaging Safety Center of Excellence

Continua a leggere questo articolo

Argomenti

Canali

ROBOTICA

-

Rotazioni fino a 600° e integrazione rapida: le novità di igus per i robot di nuova generazione

26 Mag 2026 -

Robot umanoidi: i 10 modelli che potete già comprare (più altri 11 da tenere d’occhio)

24 Mag 2026 -

Il mercato robot umanoidi cresce grazie alle applicazioni reali, ma per la commercializzazione di massa serve ancora tempo

21 Mag 2026 -

Angelini Technologies chiude il 2025 in forte crescita e punta sulla robotica

19 Mag 2026 -

McKinsey: Agenti AI e robot potrebbero sostituire già oggi il 58% dei lavori in Europa (il 60% in Italia)

19 Mag 2026