La corsa dell’intelligenza artificiale non si ferma: i progressi tecnici lasciano ormai senza parole, la diffusione di massa è la più rapida mai registrata da qualsiasi tecnologia precedente e gli investimenti crescono a ritmi incredibili. Ma non è tutto oro quel che luccica. Intanto, sul piano tecnologico, la “frontiera” appare frastagliata: a fronte di modelli in grado di vincere medaglie d’oro alle Olimpiadi di Matematica, l’AI non sa leggere un orologio analogico e l’AI fisica incorporata nei robot non è ancora affidabile. E poi emergono con urgenza richieste di trasparenza su chi controlla i modelli più potenti (spoiler: quelli cinesi hanno ormai raggiunto quelli americani), su chi paga i costi – ambientali e occupazionali – di questa crescita, e su chi ha voce in capitolo nelle scelte che la riguardano.

Di tutti questi temi si occupa l’AI Index Report 2026 dello Stanford Institute for Human-Centered AI (HAI), giunto quest’anno alla sua nona edizione.

Indice degli argomenti

Uno studio autorevole

L’AI Index Report 2026 è uno dei documenti di riferimento più autorevoli per chiunque voglia comprendere dove si trova davvero l’intelligenza artificiale: a differenza di gran parte dei report di settore, prodotti dalle stesse aziende che sviluppano i sistemi o da società di consulenza con clienti nell’industria AI, l’AI Index dell’università californiana aggrega dati da fonti terze, li verifica e li confronta nel tempo, senza interessi diretti nell’esito della valutazione. Per questo motivo è seguito e citato da governi, istituzioni di ricerca e media di tutto il mondo.

L’edizione 2026 introduce per la prima volta due capitoli autonomi dedicati all’AI nella scienza e all’AI in medicina, a testimonianza del peso crescente che la tecnologia sta assumendo in questi ambiti. Il filo conduttore del report è la distanza che si va allargando tra la velocità di evoluzione delle capacità tecniche e la capacità dei sistemi – normativi, educativi, valutativi – di tenerne il passo.

La “frontiera frastagliata”: enormi capacità… e limiti sorprendenti

Sul piano tecnico i progressi registrati nell’ultimo anno sono significativi. I modelli di frontiera – vale a dire i sistemi AI più avanzati sviluppati dai principali laboratori mondiali, come quelli di OpenAI, Google, Anthropic e i loro omologhi cinesi – oggi eguagliano o superano le prestazioni umane su questionari scientifici di livello dottorale, ragionamento multimodale e problemi di matematica da competizione internazionale: il modello Gemini Deep Think di Google ha ottenuto una medaglia d’oro alle Olimpiadi Internazionali di Matematica 2025. Il tasso di successo degli agenti AI su compiti reali è passato dal 20% del 2025 al 77,3% di oggi (secondo Terminal-Bench), mentre in ambito cybersecurity i sistemi risolvono il 93% dei problemi contro il 15% del 2024.

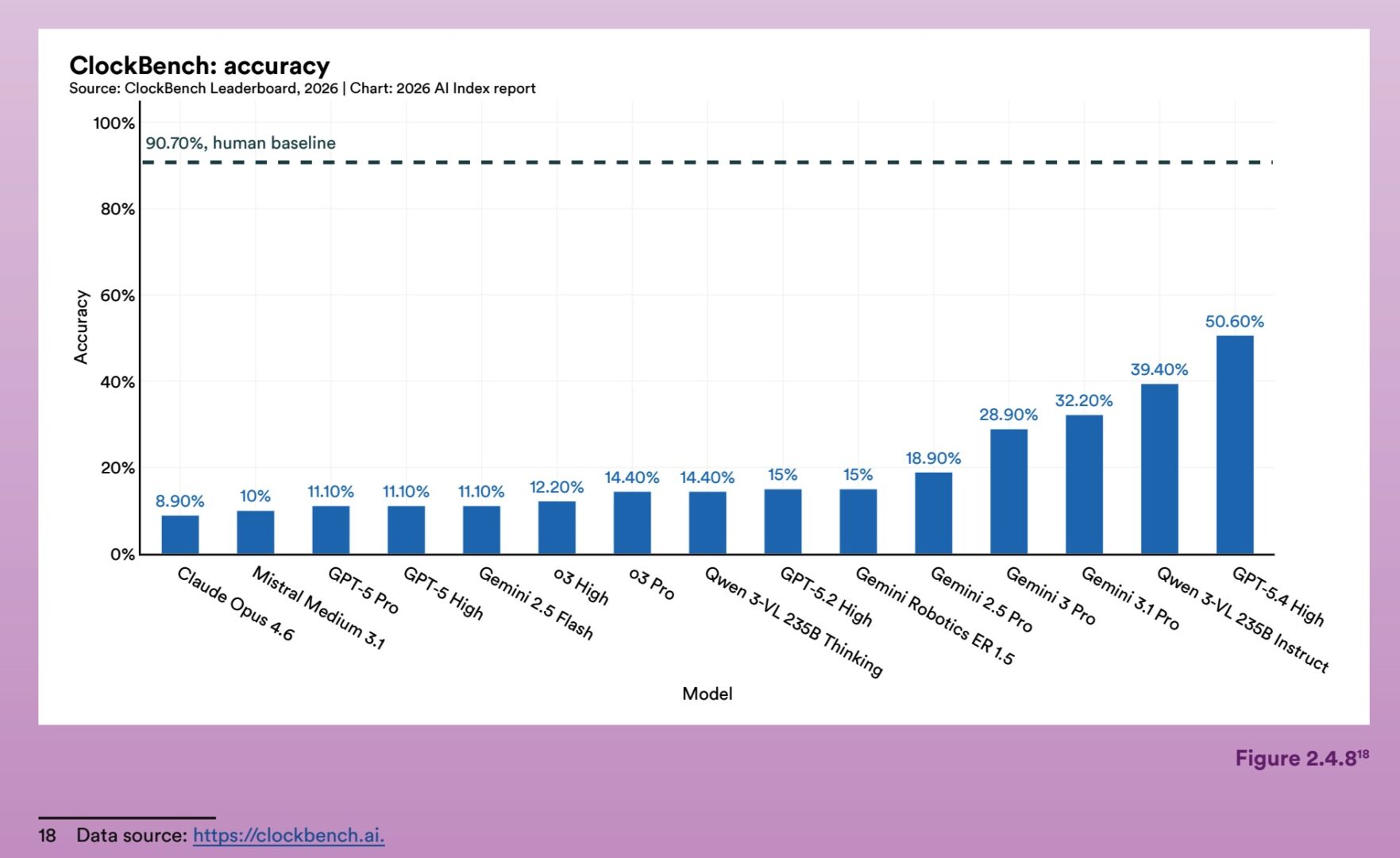

Il report introduce a questo proposito il concetto di “frontiera frastagliata” (jagged frontier): le capacità dei modelli avanzati non crescono in modo uniforme, ma presentano picchi e valli difficili da prevedere. Lo stesso sistema che vince una medaglia d’oro in matematica legge un orologio analogico con una precisione del 50,1%. E non è il solo esempio perché ci sono ancora diverse aree in cui l’AI è ancora lontana dalle aspettative: comprensione di contenuti video, pianificazione in più passaggi, analisi finanziaria complessa. Per non parlare dei robot umanoidi, massima espressione dell’AI incarnata (embodied AI) e della Physical AI, che riescono a completare con successo solo il 12% delle attività domestiche reali come riordinare o lavare i piatti.

USA vs Cina

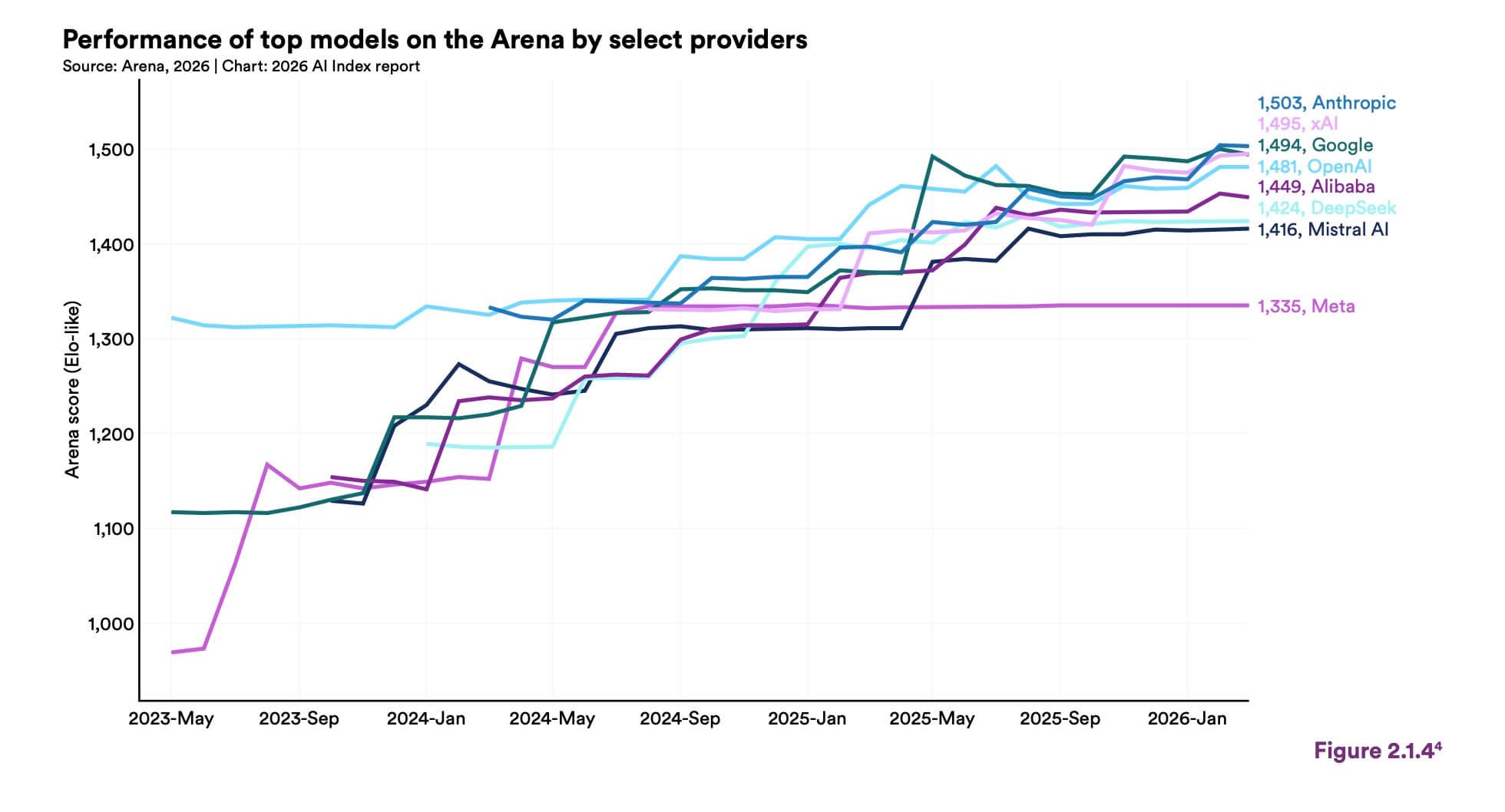

Un elemento di attenzione riguarda la convergenza tra modelli: le prestazioni dei sistemi più avanzati di USA e Cina si sono ravvicinate al punto che, come registra il report, Anthropic guida la classifica con un margine di appena il 2,7% rispetto ai principali concorrenti cinesi. DeepSeek-R1 aveva temporaneamente raggiunto il vertice già a febbraio 2025.

Il report segnala anche una crisi del talento negli Stati Uniti che potrebbe avere effetti di lungo periodo: il numero di ricercatori AI che si trasferiscono negli USA è crollato dell’89% dal 2017, con un calo dell’80% nel solo ultimo anno. E sul fronte delle infrastrutture hardware il report avverte che quasi tutti i chip AI di ultima generazione vengono prodotti da una singola fonderia taiwanese, TSMC, esponendo l’intera industria globale a un rischio di concentrazione significativo.

Investimenti in crescita, ma è in atto una forte concentrazione

Gli investimenti privati globali in AI hanno raggiunto 344,7 miliardi di dollari nel 2025 (+127,5% rispetto al 2024), all’interno di investimenti corporate complessivi che hanno toccato quota 581,7 miliardi (+130%). Il capitale non si è solo moltiplicato: si è concentrato. Gli eventi di finanziamento da oltre un miliardo di dollari sono quasi raddoppiati nel 2025, e tra i mega-progetti spicca Stargate – il consorzio formato da OpenAI, SoftBank, Oracle e Nvidia con investimenti previsti tra i 100 e i 500 miliardi di dollari per la costruzione di data center negli USA.

Gli Stati Uniti guidano con 285,9 miliardi di dollari, 23 volte più della Cina in termini di investimenti privati. Il report avverte tuttavia che questo confronto sottostima il peso cinese: Pechino canalizza risorse ingenti attraverso fondi governativi strategici, stimati in 184 miliardi di dollari destinati specificamente all’AI – e in 912 miliardi dispiegati tra il 2000 e il 2023 attraverso fondi di orientamento governativo in vari settori inclusa l’AI.

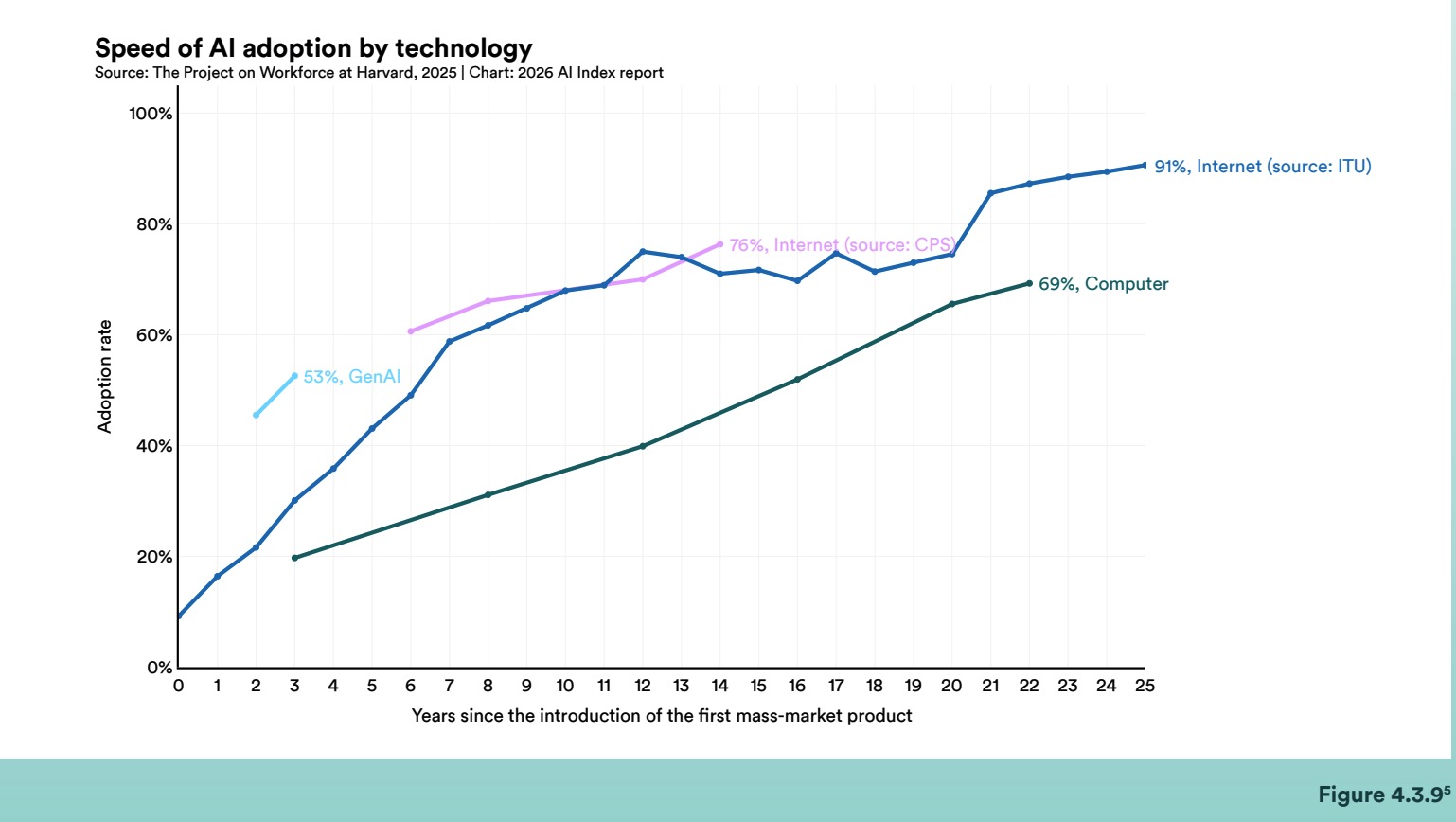

Adozione di massa: più veloce di Internet

L’AI generativa ha raggiunto il 53% della popolazione globale in tre anni, una velocità di diffusione superiore a quella del personal computer e di Internet. Il valore stimato per i consumatori americani è arrivato a 172 miliardi di dollari annui entro inizio 2026, con il valore mediano per utente triplicato rispetto al 2025 – e molti strumenti sono ancora accessibili gratuitamente. L’adozione aziendale ha raggiunto l’88% delle organizzazioni intervistate, anche se l’utilizzo di agenti AI – sistemi in grado di completare compiti in autonomia – è ancora in una fase iniziale, con percentuali a una sola cifra.

L’opinione pubblica globale è divisa: il 59% si dichiara ottimista sui benefici dell’AI (in crescita dal 52%), ma anche la quota di chi si dice nervoso è salita al 52%. Negli USA la fiducia nella capacità del governo di regolare l’AI è la più bassa tra i paesi rilevati: solo il 31%.

Il costo ambientale, il lavoro, la trasparenza

La crescita delle capacità ha un costo ambientale che il report quantifica con precisione. Le emissioni stimate per addestrare Grok 4 hanno raggiunto 72.816 tonnellate di CO2 equivalente – l’equivalente di quanto prodotto da 17.000 automobili in un anno. La capacità installata dei data center AI ha toccato 29,6 GW, paragonabile al picco di consumo dell’intero stato di New York. Il solo utilizzo idrico legato all’inferenza di GPT-4o potrebbe superare il fabbisogno di acqua potabile di 12 milioni di persone ogni anno.

Sul mercato del lavoro il report registra dati che segnalano un cambiamento strutturale già in atto. L’occupazione tra i software developer di età compresa tra 22 e 25 anni è scesa di quasi il 20% dal 2024, mentre i colleghi più senior continuano ad aumentare. Il fenomeno – che il report inquadra nella cosiddetta “curva J” dell’adozione tecnologica, per cui i costi si manifestano prima dei guadagni di produttività – si ripete in altri settori ad alta esposizione all’automazione, come il customer service. I dirigenti aziendali intervistati prevedono riduzioni di organico ancora maggiori nei prossimi mesi.

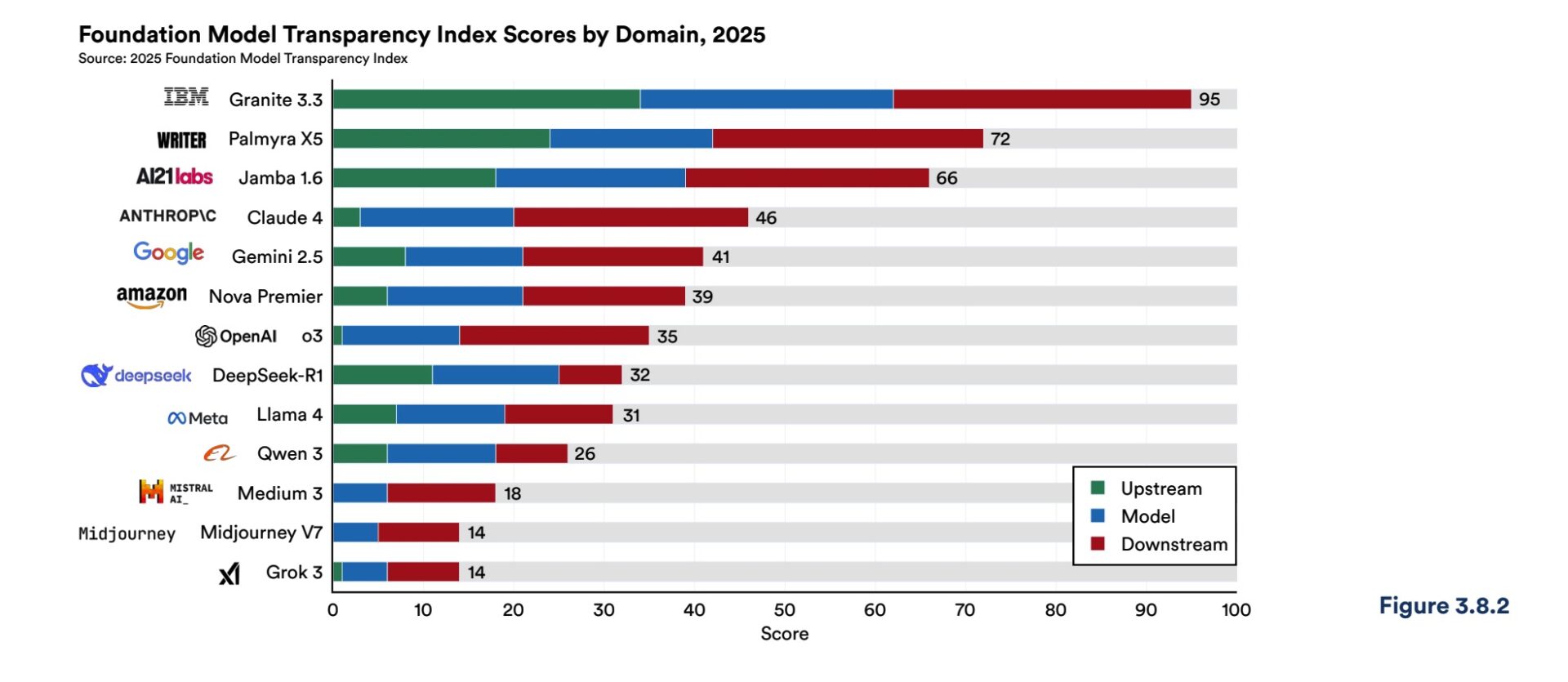

Sul fronte della trasparenza il Foundation Model Transparency Index – che misura quanto le principali aziende AI divulgano informazioni su dati di addestramento, parametri e rischi dei propri modelli – è sceso da 58 a 40 punti. OpenAI, Google e Anthropic non rilasciano più i dettagli tecnici che in passato rendevano possibile una valutazione indipendente dei loro sistemi. I modelli più potenti, osserva il report, sono spesso anche i meno trasparenti.

Un ulteriore elemento di complessità riguarda i trade-off tra dimensioni di sicurezza: migliorare una caratteristica, come la robustezza contro gli attacchi, può degradarne un’altra, come l’accuratezza delle risposte – e non esiste ancora un framework condiviso per gestire questi compromessi in modo sistematico.