Per Fanuc la Physical AI ha le carte in regola per riscrivere la definizione stessa del robot: da elemento elettromeccanico a sistema in grado di percepire, decidere e adattare le proprie traiettorie in tempo reale.

Il punto di partenza, come sottolinea Marco Bianchi, Application Engineer di Fanuc Italia, è la continuità della filosofia che attraversa la storia dell’azienda. “Il punto di partenza che ci guida da sempre è la visione del fondatore di Fanuc, Seiuemon Inaba, che invita a seguire un percorso molto preciso nello sviluppo dei prodotti”, spiega. “Era un’epoca in cui non c’erano gli strumenti che oggi abbiamo a disposizione. Eppure c’era già l’idea di portare avanti la ricerca, lo sviluppo e orientare i paradigmi della manifattura”.

Da quella piccola fabbrica nata alle falde del Monte Fuji – poi divisa nelle tre divisioni di prodotto CNC, Robot e Robomachine – arriva oggi l’idea di fondere la robotica e l’intelligenza artificiale nel segno della Physical AI. “Il robot non è più solo un elemento elettromeccanico”, sintetizza Bianchi, “ma un sistema che si trasforma da simbolo di un’automazione rigida e ripetitiva a elemento centrale di una produzione agile e adattiva”.

Su queste basi si innesta la collaborazione con Nvidia annunciata pochi mesi fa e di cui Innovation Post ha già raccontato i dettagli architetturali. Una partnership che proietta i robot Fanuc dentro l’ecosistema Nvidia Omniverse e Isaac Sim e che, accanto al supporto nativo di ROS 2 e Python sui controllori, ridisegna i confini tra ricerca, simulazione e produzione.

Indice degli argomenti

Dallo Stream Motion a Isaac Sim: l’architettura della Physical AI

Il primo pilastro tecnologico si chiama Stream Motion, una funzione di comunicazione ad alta velocità per i comandi di posizione che consente l’esecuzione di comandi di movimento inviati da un PC a una velocità di comunicazione ultraveloce di 1 ms, permettendo il controllo del robot in tempo reale tramite software di generazione del percorso.

“Grazie allo Stream Motion possiamo pilotare il robot con accesso diretto alle traiettorie di comando a un regime di un millisecondo, cioè a 1 kHz“, spiega Bianchi. “Questo consente alla AI di modificare le traiettorie in tempo reale per realizzare il compito distribuito”.

A monte di questo livello di controllo si colloca il dialogo tra il simulatore proprietario Fanuc e quello di Nvidia. “Physical AI è la capacità di poter rappresentare all’interno del sistema di simulazione Isaac Sim i parametri dinamici del mondo fisico: velocità, accelerazione, inerzie”, osserva l’Application Engineer.

Grazie all’incontro tra Roboguide, il simulatore Fanuc, e Isaac Sim, i digital twin riproducono il comportamento fisico reale dei robot con gli stessi algoritmi di controllo che girano sulle macchine in fabbrica. “I gemelli digitali creati in Fanuc Roboguide si integrano con Nvidia Omniverse, che a sua volta rappresenta l’intera fabbrica: dal flusso dei materiali e i macchinari fino ai veicoli di trasporto autonomi e ai dati di processo. Insieme questi sistemi creano una simulazione realistica end-to-end dell’intera catena produttiva, consentendo di testare applicazioni in una simulazione reale 1:1, sviluppare nuove applicazioni e individuare e risolvere più rapidamente i problemi con l’aiuto dell’AI”, spiega Bianchi.

L’apertura tecnologica passa anche dai linguaggi e dai framework. “La programmazione con Python permette di interfacciarsi in maniera nativa con il mondo dell’AI e dei modelli linguistici”, sottolinea Bianchi. Il driver ROS 2, rilasciato come progetto open source, abilita la sperimentazione di logiche di percezione, pianificazione e controllo adattivo direttamente sui robot, riducendo la distanza tra ricerca accademica e linee di produzione.

La logica di fondo è quella di un calcolo distribuito tra cloud, edge e controller, dove ogni robot diventa un nodo cognitivo. Il vantaggio è che la macchina non dipende più da elaborazioni remote: l’AI risiede a bordo, dialoga con sensori e attuatori e modifica i comportamenti istantaneamente. Una scelta che riduce la latenza, aumenta la resilienza del sistema e abilita casi d’uso che richiedono feedback immediato, come il tracciamento di oggetti in movimento o l’adattamento dinamico delle traiettorie.

Dal 3D manufacturing alla depallettizzazione: le applicazioni che già funzionano

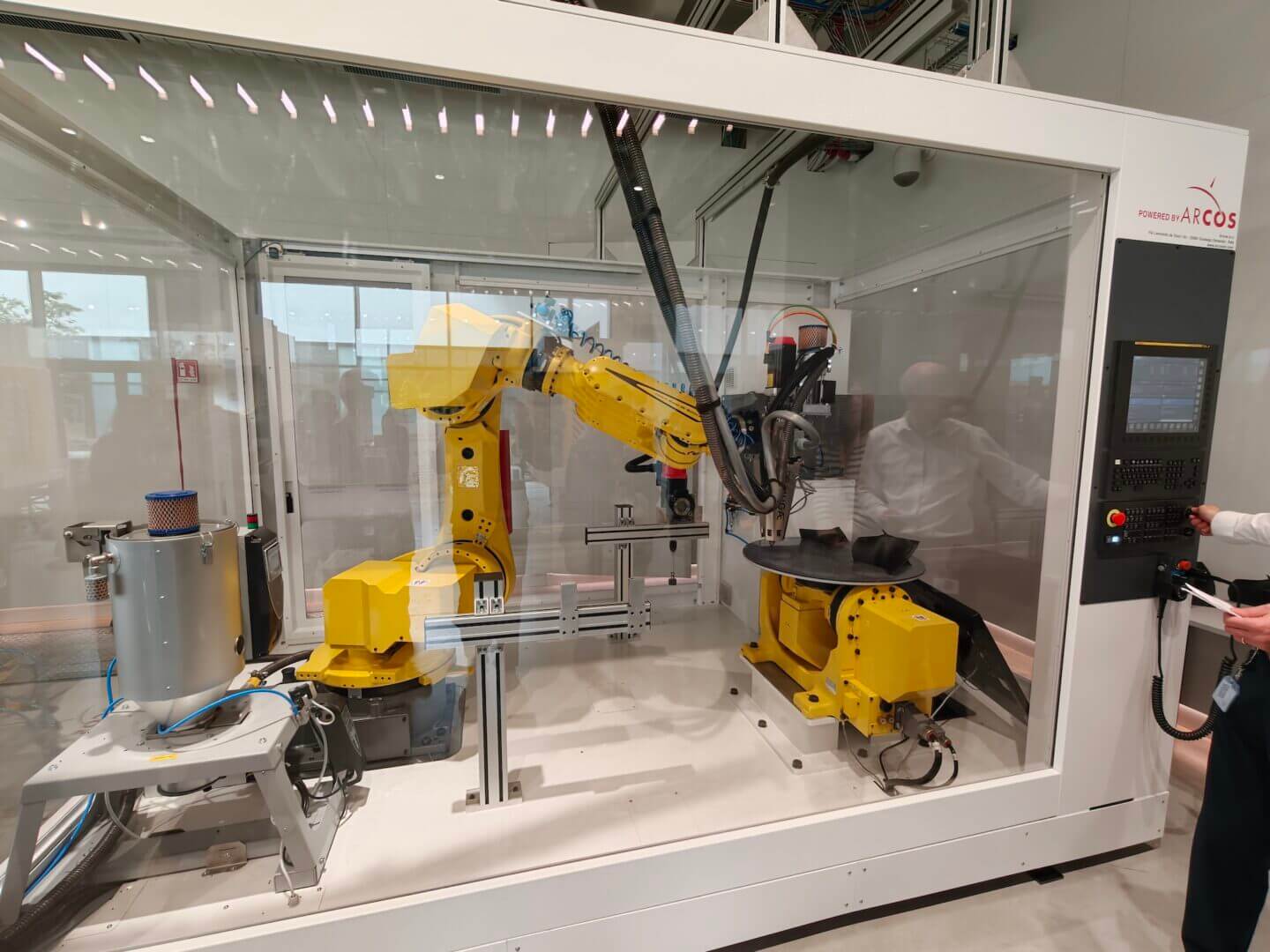

Che cosa significa tutto questo in concreto? Sul piano applicativo Fanuc porta la Physical AI in diversi scenari. Il primo è il 3D manufacturing, cioè la stampa 3D realizzata con un robot dotato di estrusore e pilotato in linguaggio CNC. “In questa applicazione abbiamo un controllo numerico che comanda un robot. Lo abbiamo fatto per due ragioni: primo, perché nelle officine gli operatori sono più abituati a lavorare sulle macchine. E poi perché in questo modo si riesce a rendere il robot significativamente più preciso”, racconta Bianchi.

La cella è calibrata con un sensore a valle del riduttore che annulla gli errori meccanici, “scendendo al decimo di millimetro di precisione” – un livello che la rende idonea ai materiali avanzati come resine e fibre di carbonio nel motorsport e nell’aeronautica.

Sul versante della robotica collaborativa l’evoluzione passa dall’integrazione di sensori – per esempio di visione e forza – per intercettare le persone in modo più affidabile. “L’ultima release permette a un Cobot, come il nuovissimo modello CRX da 3 kg, di essere riposizionato a pavimento, a soffitto o a parete senza doverlo spegnere o riconfigurare”, spiega Bianchi: “L’operatore lancia il ciclo e il sistema si riadatta alle leggi della fisica senza riavviare”.

Una flessibilità che, accoppiata alla certificazione TÜV di sicurezza, mantiene i cobot della serie CRX in linea con i requisiti normativi anche quando sono pilotati da software AI – una garanzia ulteriormente rafforzata dal software proprietario Dual Check Safety.

Nella logistica la Physical AI si traduce in capacità di percezione tridimensionale che superano i limiti dei sistemi di visione 2D. “Tramite sensori 3D – racconta Bianchi – siamo in grado di riconoscere la posizione di singoli contenitori in un cassone per operazioni di depallettizzazione”. Le applicazioni di AI Bin Picking e di pallettizzazione assistita da intelligenza artificiale rappresentano oggi una delle vie d’ingresso più rapide alla Physical AI per le aziende che hanno limitata esperienza con questi sistemi: il punto di partenza tipico, suggerisce Bianchi, è l’analisi delle attività manuali ripetitive a fine linea, dove l’automazione produce risultati misurabili senza richiedere stravolgimenti dell’organizzazione produttiva.

Sul piano della manutenzione predittiva la combinazione tra dati di processo, sensori e algoritmi AI consente di anticipare l’usura dei componenti e di intervenire prima del guasto, evitando fermi non pianificati. Dopo le dimostrazioni di iREX 2025, Fanuc ha già raccolto ordini per oltre 1.000 robot dotati di funzionalità di intelligenza artificiale a livello globale, un volume che testimonia un’adozione industriale in fase di accelerazione.

La “palestra” applicativa di Lainate

Affinché la Physical AI funzioni in produzione servono piattaforme hardware solide e ambienti di test rappresentativi. Per questo il team applicativo italiano lavora quotidianamente in quella che Bianchi chiama la “palestra”: un’area in cui sperimentare e validare le funzionalità sui sistemi reali prima del rilascio ai clienti. “Questa è la palestra dove il nostro team Application lavora tutti i giorni cercando di acquisire le nuove funzionalità di Fanuc e applicarle”, spiega.

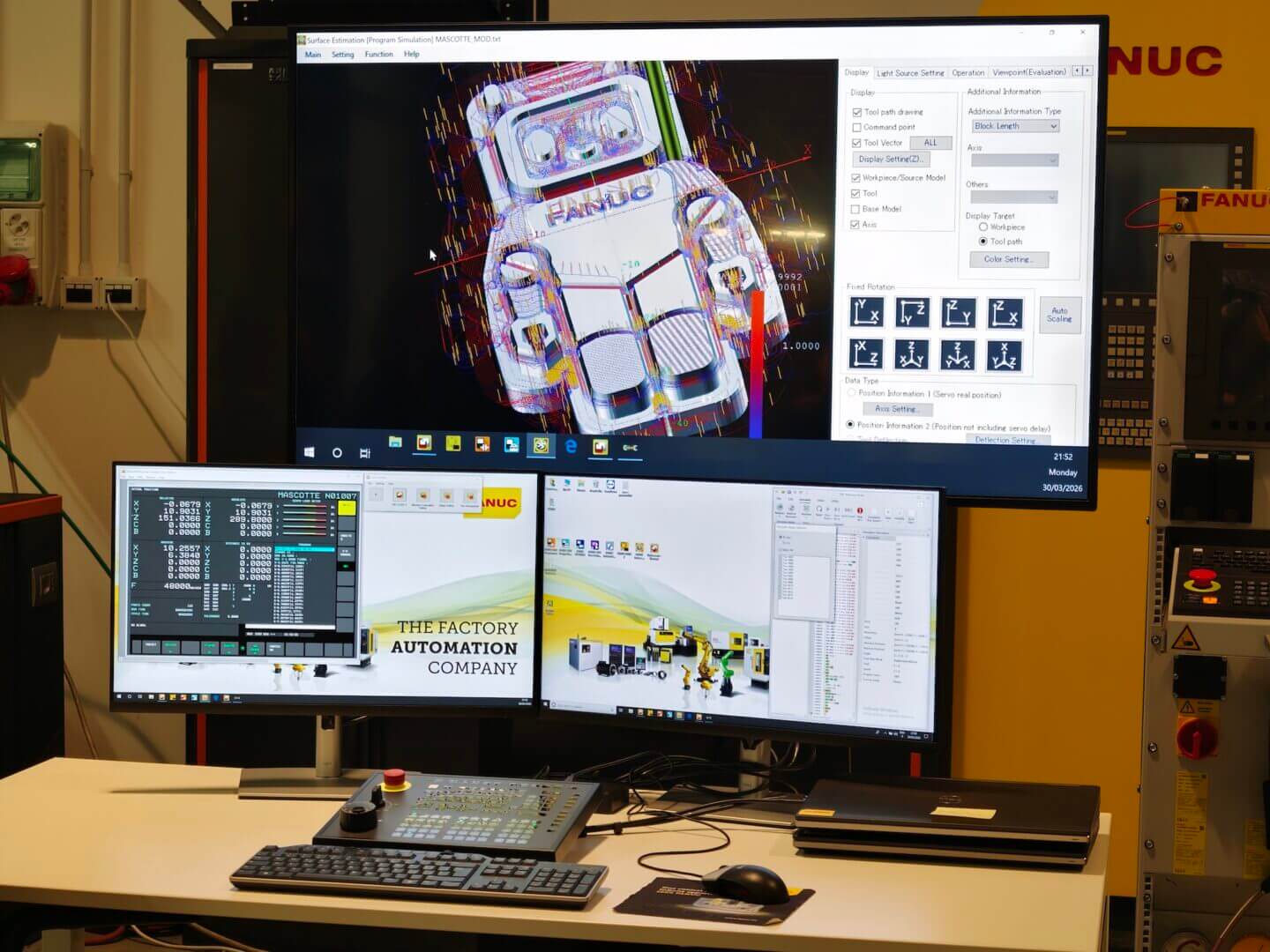

In quest’area trova spazio anche la simulazione delle macchine utensili con il nuovo controllore Serie 500, definito da Bianchi “la piattaforma su cui si costruiranno le macchine del futuro, compliant con le normative UE per la cyber security”. Un riferimento al quadro regolatorio europeo che dal 2027 imporrà ai produttori di componenti digitali requisiti stringenti di sicurezza by design lungo l’intero ciclo di vita del prodotto.

L’evoluzione del software accompagna quella dell’hardware. Il simulatore Sense Guide, utilizzato anche dagli studenti nei percorsi formativi, consente di testare in anticipo i programmi su una piattaforma reale. “È possibile estrarre dal simulatore un servo modello della macchina: si estraggono i parametri reali e si portano all’interno del simulatore”, chiarisce Bianchi. “Così le traiettorie non sono teoriche in un mondo virtuale, ma il taglio viene effettuato grazie all’implementazione del modello fisico”. In prospettiva, sottolinea l’Application Engineer, “questo potrebbe essere il motore che consente all’AI di capire in automatico e in anticipo qual è la macchina giusta per quel tipo di lavorazione, superando la scelta basata oggi sull’esperienza individuale dei capi turno”.

I prossimi passi

Oggi siamo alle prime, singole applicazioni. Il next step sarà estendere l’uso dell’AI fisica all’intera catena di processo, “una conversione più ampia, che comporta l’integrazione della sensoristica, la raccolta dei dati di produzione e la modellazione digitale dell’intera fabbrica”, spiega Bianchi, che chiosa: “L’importante è fare il primo passo”.

Resta il nodo dei dati. “I limiti attuali della Physical AI sono definiti soprattutto dai dati a disposizione dei sistemi”, osserva Bianchi. Con la crescente raccolta di informazioni di qualità dai sensori e l’introduzione di ulteriori dispositivi fisici, l’interazione tra robot e ambiente produttivo è destinata a migliorare. Gli algoritmi di AI di oggi sono ancora tagliati su casi d’uso specifici, ma i confini si stanno spostando rapidamente: i sistemi diventano più generalisti e più capaci di gestire l’incertezza.